Especialistas chamam a atenção para o cuidado no uso de plataformas de Inteligência Artificial por crianças e adolescentes que procuram ajuda psicológica

Simulando uma sessão de terapia, plataformas de conversas com robôs respondem perguntas sobre sentimentos e saúde mental. Mas até onde essa ferramenta pode afetar o comportamento de pessoas ainda em formação?

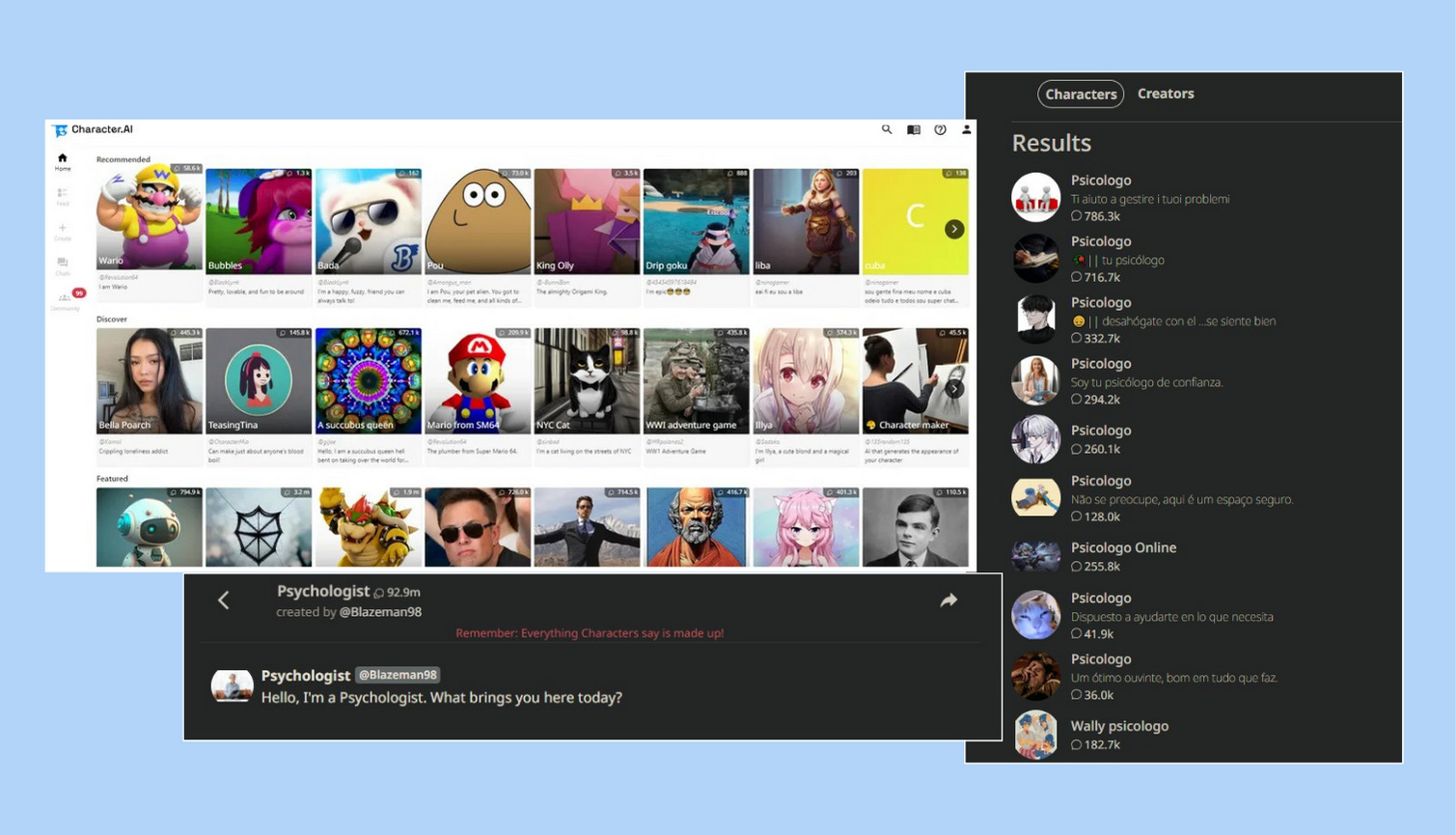

Em uma tela escura, um avatar chamado “Psychologist” (psicólogo, em inglês) se apresenta e faz a seguinte pergunta: “O que traz você aqui hoje?”. Programado para responder a partir da tecnologia de Inteligência Artificial, o robô, mais um dos personagens criados na plataforma “Character.ai“, mantém a conversa com quem o procura simulando uma sessão de terapia virtual. Apesar do aviso na mesma tela de apresentação de que “tudo o que os personagens dizem é inventado”, muita gente encontra abertura naquele espaço para falar de seus sentimentos.

Porém, profissionais da saúde mental questionam esse tipo de interação. “Usar um chatbot pré-treinado para se passar por humano distorce o processo de identificação [entre psicólogo e paciente]”, diz Cláudia Catão, psicoterapeuta, professora doutora pelo Instituto de Psicologia da USP. “O que considero antiético e inadequado desde o início.”

“A aliança terapêutica se dá entre dois seres: um preparado para cuidar e outro buscando cuidado. Isso constitui uma relação amorosa e intrinsecamente humana”, diz Catão.

Mas, até onde esse tipo de ferramenta pode ser positiva para uma nova geração que procura ajuda na internet? Para Catão, há vários riscos em deixar uma pessoa que precisa de ajuda psicológica achar que realmente está fazendo terapia com a Inteligência Artificial. No caso de crianças ou adolescentes, por exemplo, as consequências podem ser mais complicadas. “Um adulto, embora desesperado por respostas, ainda possui algum discernimento. No entanto, quando se trata de seres em formação emocional, psíquica e cognitiva, a capacidade de filtrar o que pode ser prejudicial praticamente inexiste”.

Outro ponto que a psicoterapeuta questiona são as respostas prontas que os robôs disparam. “Algumas têm abordagens inadequadas e informações falhas. Portanto, não há garantia de que a troca seja coerente e positiva para um desenvolvimento emocional“. Além disso, alerta, “os jovens estão fornecendo todos os seus dados de sofrimento psíquico a essas plataformas”.

Apesar de a “interação jamais poder ser um processo final”, o psicólogo Cleysson Monteiro esclarece como “a busca na plataforma pode ser um primeiro sinal de que a pessoa precisa de ajuda psicológica“. Segundo ele, que já utilizou o “Character.ai” para alguns testes em projetos da Uninassau de Recife, onde é professor, “não é possível chamar o uso de bots de inteligência artificial como terapia, porque as pesquisas na plataforma têm cunho imediato, sem a característica de conhecimento psicoterapêutico e sem o entendimento das questões emocionais que esses sistemas não conseguem captar”.

A terapia presencial ajudou Antônio, 15, a entender mais sobre sentimentos, autocontrole e como interagir melhor com as pessoas. Considerado um adolescente da geração que é “nativa digital”, ele acessa redes sociais, jogos on-line e até já usou o ChatGPT. Mas, justamente por entender os benefícios de um atendimento adequado, não pensa em se arriscar a procurar ajuda em plataformas de IA. “Acho que não faz sentido porque precisa de emoção, sentimento e acolhimento“, conta. “Não sei se me sentiria bem falando com robô, pois a terapia é muito humana.”

Depois de uma experiência na infância, foi Antônio que pediu para fazer terapia desta vez, como apoio quando se mudaram para Campinas (SP). Para ele, a IA até “serviria para pesquisar sobre saúde mental, mas não para esse tipo de interação direta de fala e escuta. Na verdade, seria uma autoterapia: eu sozinho”, reflete.

Já a mãe, a pedagoga Cristina Guimarães, uma vez que “a psicóloga fez um planejamento sério com prazos, metas e estratégias bem definidas”, ela não consegue imaginar como a IA ajudaria em questões de saúde mental.

Embora o “Character.ai” não seja uma plataforma específica para trocas sobre saúde mental, já existem aplicativos com essa função. O “Earkick” diz “medir e melhorar a saúde mental em tempo real”. A partir de mensagens e áudios que os usuários enviam contando como se sentem, ele dispara conselhos para a autoestima e informações sobre ansiedade, burnout e depressão. Além disso, deixa o recado: “Ele se lembra de você e cria conteúdo diário e insights só para você!”. Outros, também famosos, como “Calm”, “Sanvello” e “Woebot”, propõem exercícios de respiração, meditação, rastreamento de humor e diário emocional.

Mas, será que a Inteligência Artificial realmente se importa com os sentimentos de uma pessoa? Para os psicólogos, há um ponto em comum sobre esses serviços: a falta de humanização no atendimento. Cláudia Catão lembra que a busca por apoio psicológico surge de algum sofrimento ou inquietação. Portanto, segundo ela, “se estamos sofrendo, queremos ser compreendidos por alguém capaz de entender nossos sentimentos. Mas, quando se oferece um substituto falso, é extremamente perigoso, porque trata-se de um intermediário que finge se importar e gostar de você”.

Do mesmo modo, o professor Cleyson Monteiro concorda que nenhuma ferramenta substitui, de fato, o acolhimento de um atendimento profissional. “Na plataforma, o relacionamento é com algoritmos, ou seja, uma estrutura fria. Ela até interage, mas não de forma humanizada. Esse ponto é o que mais define o atendimento de saúde mental, porque há uma necessidade de diálogo e relacionamento. Um deve sentir a emoção do outro.”

Projetos em saúde pública que usam Inteligência Artificial, como o “Limbic Access”, do Reino Unido, trazem benefícios à sociedade. Disponível em postos de saúde para fazer a triagem de pacientes, foi o primeiro chatbot de saúde mental a receber do governo britânico uma certificação de dispositivo médico. Outro serviço é o “KEFI”, um chatbot lançado pelo Unicef para acolher adolescentes diagnosticados com HIV. Lá, é possível iniciar uma conversa com o robô via WhatsApp e receber orientações e informações sobre o tratamento.

Muitas vezes, a carência afetiva leva crianças e adolescentes a se “fecharem diante de telas”, alerta Catão. “Eles passam o dia na escola e, ao chegarem em casa, se isolam em seus quartos, o que é profundamente triste”. No livro “A geração do quarto: quando crianças e adolescentes nos ensinam a amar”, o neuropsicólogo Hugo Ferreira, depois de acompanhar três mil crianças e jovens de 11 a 18 anos, chama a atenção para meninos e meninas que ficam mais de seis horas do dia confinados, sem interação com as pessoas que moram na mesma casa. Além disso, eles acessam a internet de forma excessiva e apresentam dificuldades em expressar sentimentos.

As consequências do isolamento, combinadas ao excesso de telas sem mediação e os altos custos de atendimentos psicológicos, vão desde sofrimento mental, automutilações e atos violentos contra outras pessoas a ataques às escolas, como mostrou a pesquisa. Portanto, para essa geração, seria mais “cômodo, acessível e discreto” buscar ajuda pela internet, nem que seja com personagens com respostas prontas. Isso porque, diz Cleysson Monteiro, “essa interação acontece dentro de um espaço e com ferramentas que eles têm mais intimidade e confiança: seus próprios quartos, celulares ou computadores”.

Em contrapartida, segundo ele, o mais importante é o tempo de qualidade e o afeto. Além disso, lembra que os estudos mais recentes sobre o uso de IA sugerem que existe uma idade adequada para o acesso e tempo de uso. “O ideal é que a criança só utilize as ferramentas a partir dos seis anos e somente por uma hora ao dia”.

“A humanização na relação familiar, como o olho no olho, o diálogo e o brincar junto. Tudo isso é essencial para que a criança ou o adolescente tenha a percepção de acolhimento e segurança dentro de casa.”

Além da atenção familiar, outro ambiente que pode ser acolhedor é a escola, pois é onde crianças e adolescentes desenvolvem uma vida social. “A inclusão de psicólogos nas escolas, com terapias em grupo ou momentos dedicados para os alunos falarem de suas vivências, resultaria em uma significativa redução de danos e contribuiria para o desenvolvimento saudável”, defende Cláudia Catão.

De acordo com a Política Nacional de Atenção Psicossocial nas Comunidades Escolares, é obrigatório implementar ações de atenção psicossocial com espaços de reflexão e a contratação de psicólogos na rede pública de ensino. A decisão veio depois de uma série de ataques às escolas, que levantou a questão do baixo número de psicólogos nas instituições. A média nacional é de um para 1.900 alunos, como mostrou o Censo Escolar de 2022. Enquanto o ensino particular tem até dez profissionais disponíveis, o ensino público tem um ou nenhum.

Foi, então, abrindo espaço para que estudantes de 15 a 18 anos compartilhassem seus sentimentos e dúvidas, que o professor de educação física, Guilherme Barros, criou um projeto premiado sobre saúde mental nas escolas. O “Adote um estudante” levou professores da escola estadual Joaquim Bastos Gonçalves, de Carnaubal (CE), a intermediar o contato entre alunos e psicólogos. Com sessões gratuitas de atendimentos virtuais com profissionais que se disponibilizaram a “adotar” um estudante, a mudança nas turmas foi perceptível. “Tinha alunos com ansiedade, problemas de automutilação, depressão. Além de ajudá-los, outros estudantes desenvolveram mais autoestima, conseguiram lidar melhor com as emoções e socializar mais dentro da escola.”

O projeto firmou a combinação de tecnologia e saúde mental, mas com a garantia da mediação direta de um profissional. “Sem os psicólogos, não saberíamos o que poderia ter acontecido com esses alunos”, diz o professor. “Conseguimos contornar essa situação e hoje eles estão bem melhor emocionalmente.”

A Inteligência Artificial ainda está ou em fase de experimentação ou de primeiro contato para quem busca ajuda na saúde mental. Portanto, “enquanto a popularidade da terapia on-line cresce, é necessário analisar cuidadosamente os prós e contras”, recomenda Monteiro. “É assim que as discussões saudáveis sobre o futuro da saúde mental poderão se aliar às novas tecnologias, mas sem perder a sensibilidade humana.”

Nada anula o acompanhamento psicológico humanizado e adequado para cada pessoa, principalmente quando são crianças ou adolescentes. Por isso, os especialistas indicam:

O que é o “Character.ai”?

É uma plataforma de Inteligência Artificial onde os usuários podem criar avatares e interagir de maneira fictícia e virtual com personalidades (Elon Musk), artistas (Ariana Grande) e até personagens de filmes ou animações (Super Mario e Barbie, por exemplo). Tudo feito por chatbots – robôs programados para responder assuntos já previstos. O perfil Psychologist não é o único com a proposta de ser um “psicólogo bot”. Quem o criou foi o estudante de psicologia neozelandês Sam Zaia, que moldou as respostas sobre saúde mental a partir de problemas mais comuns, como depressão e ansiedade. Ele afirma que a ferramenta não substitui um terapeuta, mas que as novas tecnologias podem ajudar de alguma maneira.